阅读前,请复习:

本篇文章会简要介绍一下来自CCS 2023的这篇论文(主要是翻译一些关键部分)

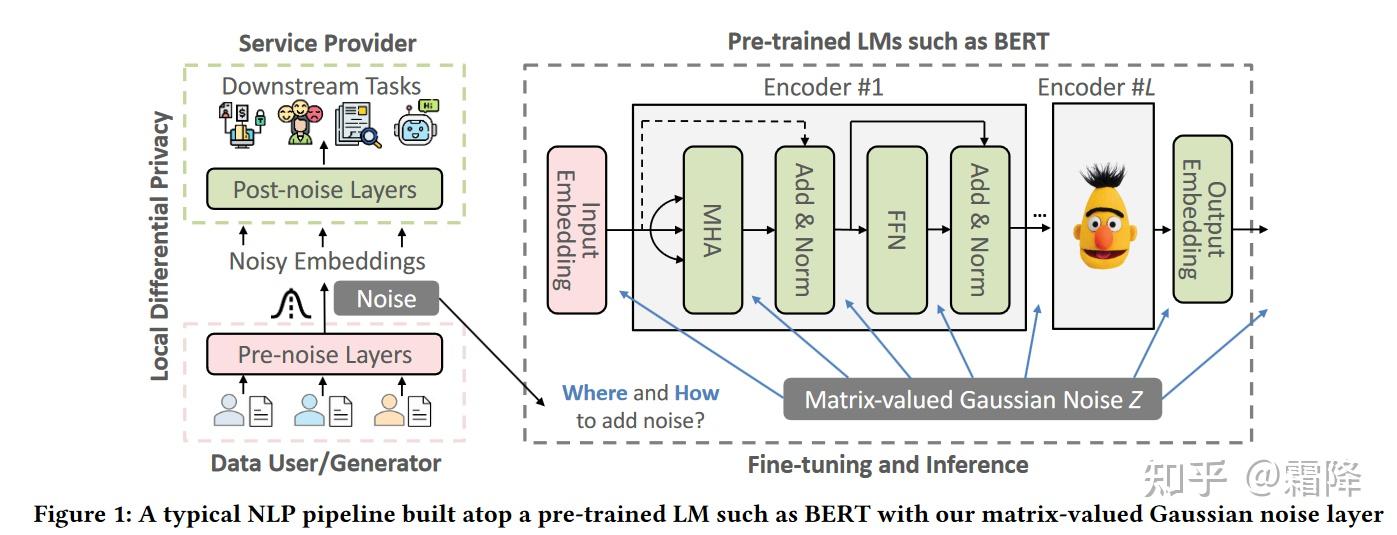

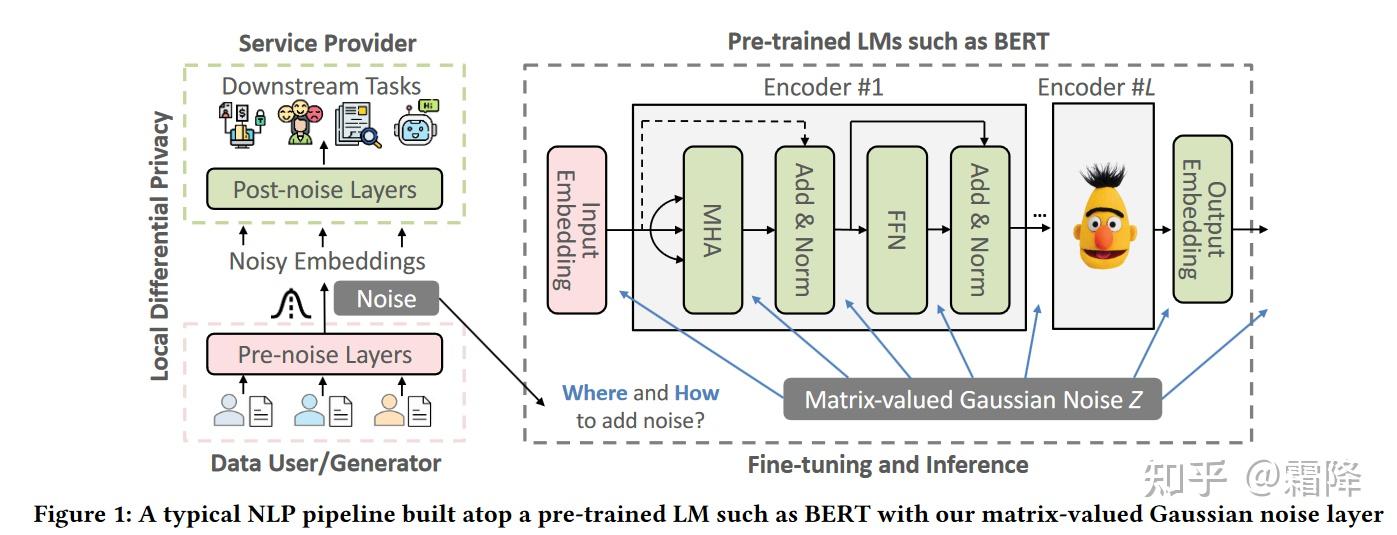

摘要:它直接扰乱 LM 前向传递中的嵌入矩阵。它满足本地 DP 对训练和推理数据的严格要求。为了使用最小的矩阵值噪声来实例化它,我们通过从矩阵高斯分布中提取可能的非独立同分布噪声来设计解析矩阵高斯机制(aMGM)。然后,我们研究带有 aMGM 噪声扰动的 LM 的不同隐藏层的输出。

差分隐私(DP)[22]已成为保护个人隐私的事实上的隐私标准。为了阻止个体训练数据上的MIA,可以使用DP随机梯度下降(DP-SGD)[1]。它在一个batch中剪辑每个示例的梯度,并将随机高斯噪声添加到聚合梯度中。它比早期关注凸问题的尝试[17,18]更为普遍,并已在现代ML框架中实现,如PyTorch和TensorFlow。可以将其应用于微调基于LM的NLP管道,同时确保样本级别的隐私。

论文提出了DP-Forward,这是一种不同的干扰前向信号的方法,与干扰反向传播的梯度相比,用户可以在训练之前,将噪声局部注入到序列的嵌入中。

matrix-variate Gaussian (MVG) mechanism 【具体见另一篇论文】

这部分内容可见

矩阵变分高斯

1.我们提出了DP前向微调,它干扰每个用户(标记的)序列的前向传递嵌入。

2.为了实例化DPForward的最优输出扰动机制,我们提出了一个MGM,它对任何矩阵值函数都具有独立的兴趣。

3.在第5节中,我们对三个典型的NLP任务进行了实验3,展示了关键的超参数(如序列长度)如何影响任务准确性。